周末小明和家人去公园拍照,按下快门后,手机里的照片很快就显示出清晰的人脸,连奶奶眼角的细纹都能看清,可他记得以前用旧手机拍照时,经常出现人脸模糊的情况。这背后,正是计算机视觉在悄悄发挥作用。

计算机视觉会先在拍摄的瞬间快速 “扫描” 整个画面,就像我们用眼睛在照片里找人脸一样,它能通过识别眼睛、鼻子、嘴巴这些面部特征的形状和位置,精准定位出画面中的人脸区域。接着,它会把重点 “注意力” 放在人脸区域,对这个部分进行特殊处理。比如当光线不足导致人脸偏暗时,计算机视觉会分析人脸不同部位的亮度,自动调整暗部的亮度,让五官更突出;要是拍摄时有点手抖,导致人脸轻微模糊,它还能根据周围清晰的像素信息,对模糊的像素进行修复和补充,就像给模糊的人脸 “修图” 一样,让人脸逐渐变得清晰。

为什么手机相册里的照片能被自动分类成人像、风景、美食等不同类别?

这就像我们整理相册时会根据照片内容分类一样,计算机视觉有自己的 “分类标准”。它会先提取每张照片里的关键特征,比如人像照片里会有明显的人脸特征,风景照片里会有天空、山脉、河流这些元素,美食照片里则有特定的色彩和食物形状。然后,它会把这些提取到的特征和已经 “学习” 过的大量样本特征进行对比,比如之前已经告诉过它什么样的特征属于人像、什么样的属于风景,当对比发现某张照片的特征和人像样本特征高度匹配时,就会把这张照片归到人像类别里。

在超市自助结账时,计算机视觉怎么知道我们拿的是什么商品?

超市里的每样商品都有自己独特的 “身份标识”,比如包装的形状、颜色、上面的文字或图案,这些就像商品的 “外貌特征”。计算机视觉在自助结账系统里,会先对我们放在结账台上的商品进行拍摄,然后提取商品的这些 “外貌特征”。之后,它会去匹配超市数据库里存储的所有商品信息,数据库里记录了每样商品对应的 “外貌特征” 和价格等信息。当找到和提取出的 “外貌特征” 完全一样的商品信息时,就知道我们拿的是该商品,并且会显示出对应的价格,方便我们付款。

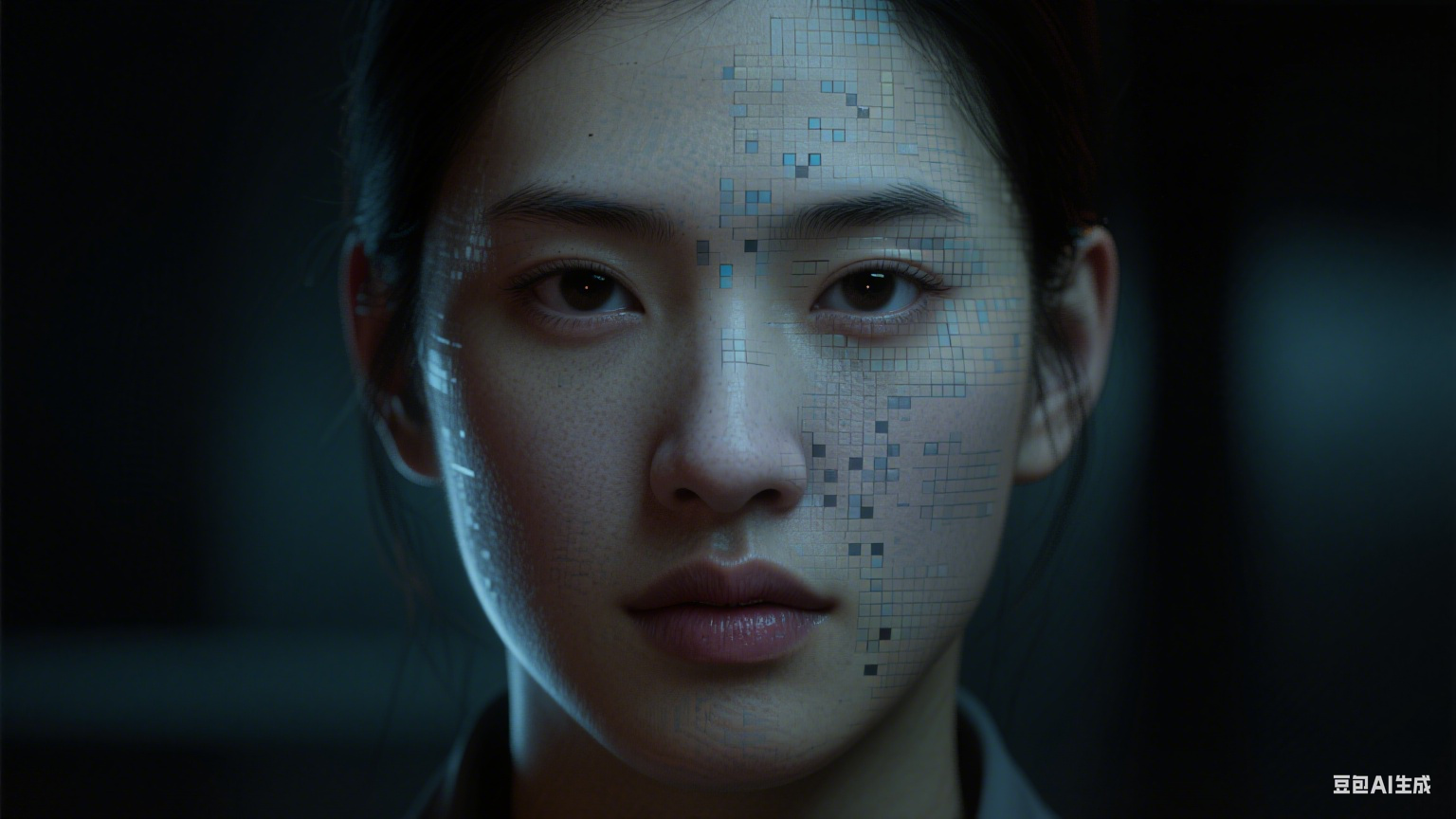

手机上的美颜功能,计算机视觉是如何做到只美化人脸而不影响背景的?

小丽每次用手机自拍后都会用美颜功能,她发现美颜只会让自己的皮肤变光滑、眼睛变大,背景里的花草树木却没有变化。其实,计算机视觉在美颜时会先精准 “圈出” 人脸区域,它通过识别面部的轮廓、五官位置等特征,确定哪些部分是人脸,哪些部分是背景。然后,它会对 “圈出” 的人脸区域单独进行处理,比如去除皮肤上的瑕疵时,只会对人脸区域的像素进行调整;放大眼睛时,也只针对眼睛所在的小区域进行变形处理。而对于人脸之外的背景区域,计算机视觉会 “忽略” 它们,不进行任何美化操作,这样就实现了只美化人脸不影响背景的效果。

在停车场找车时,有些 APP 能通过拍照帮我们找到车辆,计算机视觉是如何实现的?

当我们在停车场停车后,用 APP 拍照记录车辆位置时,计算机视觉会先提取照片里车辆的特征,比如车辆的颜色、车型、车牌号码,还有车辆周围的环境特征,像旁边的柱子、指示牌等。之后,当我们想找车,再次用 APP 拍照时,计算机视觉会提取当前拍照场景的特征,并和之前记录的车辆特征及周围环境特征进行对比。如果发现当前场景里有和之前记录的车辆特征一致的车辆,并且周围环境特征也能匹配上,比如旁边的柱子和之前照片里的柱子一样,就会告诉我们该车辆就是我们要找的车,还能根据位置信息指引我们找到车辆。

计算机视觉在识别手写文字时,是怎样区分不同的字体和潦草的字迹的?

老师用手机扫描学生的手写作业,计算机视觉能准确识别出作业上的文字内容,哪怕有些学生的字迹比较潦草。这是因为计算机视觉在识别手写文字前,已经 “学习” 了大量不同字体、不同潦草程度的文字样本。它会先对扫描到的手写文字进行处理,把文字从纸张背景中分离出来,然后提取文字的笔画形状、笔画顺序、字体结构等特征。不管是工整的楷书,还是潦草的行书,每个文字都有其独特的笔画特征,计算机视觉会把提取到的特征和 “学习” 过的样本特征进行对比,即使字迹潦草,只要关键的笔画特征能和某个文字样本特征对应上,就能准确识别出该文字。

在智能家居里,计算机视觉如何通过摄像头判断家里是否有人,从而自动开关灯?

智能家居的摄像头会实时拍摄家里的画面,计算机视觉会不断对拍摄到的画面进行分析。它会先识别画面中是否有类似人体的轮廓特征,比如人的身高、体型、肢体动作等。当画面中出现符合人体轮廓特征的物体,并且这个物体还能做出类似人走路、抬手等动作时,计算机视觉就会判断家里有人,然后向灯光控制系统发送信号,让灯自动打开。如果长时间在画面中没有检测到人体轮廓特征和相关动作,计算机视觉就会判断家里没人,进而发送信号让灯自动关闭,达到节能的效果。

为什么有些图片编辑软件能自动去除图片里的水印,计算机视觉是如何做到的?

我们在网上下载的一些图片会带有水印,用图片编辑软件的去水印功能就能把水印去掉。计算机视觉首先会识别图片里的水印,它通过分析水印的颜色、形状、位置以及水印和图片背景的差异,比如水印通常是半透明的,颜色和背景有明显区别,从而确定水印在图片中的具体区域。然后,它会根据水印周围的图片内容,对水印区域进行修复。比如水印在一片蓝天区域,计算机视觉会提取水印周围蓝天的颜色和纹理信息,用这些信息去填充水印所在的区域,让填充后的区域和周围的蓝天融为一体,看起来就像没有水印一样。

在快递分拣中心,计算机视觉怎么帮助分拣员快速区分不同目的地的快递包裹?

快递包裹上都会贴有快递单,快递单上有目的地信息,比如收件地址、邮政编码等,这些信息通常以文字或条形码、二维码的形式存在。计算机视觉在快递分拣中心,会通过摄像头拍摄快递包裹上的快递单,然后识别快递单上的文字信息或解码条形码、二维码,获取到包裹的目的地信息。之后,它会根据目的地信息,将包裹分配到对应的分拣通道,比如目的地是北京的包裹,就会被分配到发往北京的分拣通道,分拣员只需要把包裹放到对应的通道里即可,大大提高了分拣速度。

计算机视觉在辅助驾驶中,如何识别道路上的行人并提醒司机注意?

辅助驾驶系统中的摄像头会实时拍摄前方道路画面,计算机视觉会对画面进行实时分析。它会先提取画面中物体的特征,比如行人的身高、体型、走路的姿态等,这些特征和车辆、树木等其他物体有明显区别。当计算机视觉检测到画面中有符合行人特征的物体时,会进一步确认该物体是否在道路范围内,比如是否在人行横道上或横穿马路。如果确认是道路上的行人,就会向司机发出提醒,比如在仪表盘上显示警示图标或发出警报声,让司机及时减速或停车,避免发生事故。

在图书馆里,计算机视觉如何帮助工作人员快速找到被放错位置的图书?

图书馆里的每本书都有自己的编号和对应的书架位置信息,这些信息会存储在图书馆的数据库里。计算机视觉会通过摄像头拍摄书架上的图书,然后识别每本书书脊上的编号或文字信息。之后,它会把识别到的图书编号和数据库里存储的图书编号及对应位置信息进行对比。如果发现某本书的编号对应的位置和它当前所在的书架位置不一致,比如编号为 A123 的书应该放在第一排书架,却出现在了第三排书架,计算机视觉就会把这个信息反馈给工作人员,工作人员根据反馈就能快速找到放错位置的图书,并将其放回正确的位置。

免责声明:文章内容来自互联网,本站仅提供信息存储空间服务,真实性请自行鉴别,本站不承担任何责任,如有侵权等情况,请与本站联系删除。